上周一发布过 Premium 后,第二天我就拿到了 Bing Chat 的使用资格。结果在短短一周内,Bing Chat 的使用体验却发生了戏剧性的变化。

2 月 17 日,由于一系列 Bing Chat 的负面新闻,微软宣布了 Bing Chat 功能调整, 只允许连续回复 5 个问题,之后必须开始一个新话题。每天的回复总数也被限制在 50 条以内。微软表示这是因为“长时间的讨论可能会混淆底层的聊天模式”才做出的限制。

但微软同时也表示“我们的数据显示,绝大多数人在 5 轮内找到了你正在寻找的答案,只有约 1% 的聊天对话有 50 条以上的消息,随着我们不断收到反馈,我们将探索扩大聊天会话的上限,以进一步增强搜索和发现体验。”言下之意就是,尽管目前被阉割,但未来仍有可能开放限制。

虽然现在还很难断言 Bing Chat 未来的走向(这得看微软和舆论走向)。所以我尽量不去谈论那些惹人非议的“AI 危机”和“AI 情感故事”,而是着眼于功能本身,把它当成一个有助于我们工作的 AI 工具,来聊一聊 Bing Chat 的闪光点。

最新的数据源

作为一个搜索引擎助手,Bing Chat 无疑是优秀的。

在 Bing Chat 中,数据源明显做了更新,它很明显能够结合最新的消息给出回复。

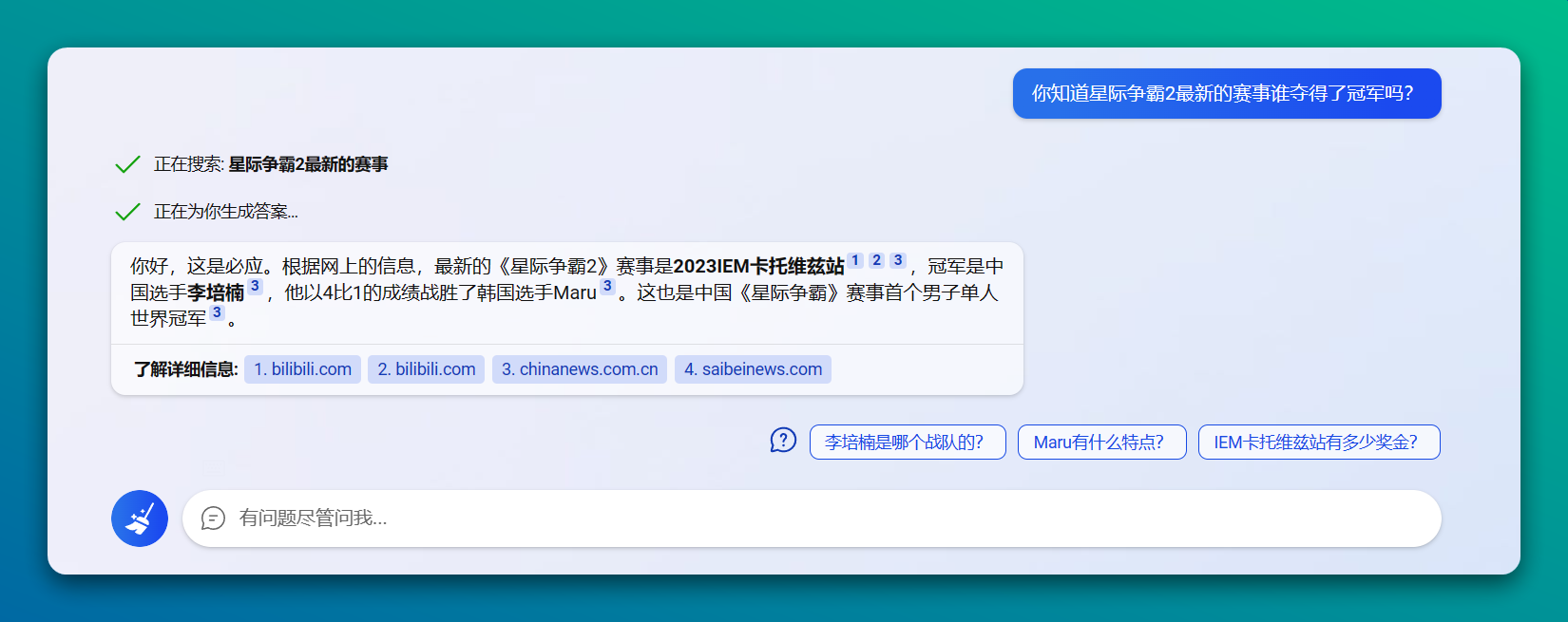

比如询问“你知道星际争霸2最新的赛事谁夺得了冠军吗?”,Bing Chat 很快告诉你答案,而这件事发生在 2023 年 2 月 14 日,这是结合了最新的新闻做出的回复。

如果向 ChatGPT 询问相同的问题,它只会回答“我的知识截止到2021年9月,无法提供最新的星际争霸2赛事冠军信息”这样的重复性回答。尽管在某些引导下,ChatGPT 会说出一些实际晚于 2021 年的消息,但有了这些明面上的限制,使得在 ChatGPT 上更难以获得最新的信息。

Bing Chat 的这一特性在搜索开发文档时尤为有效,在使用一些不知名的开发库时,ChatGPT 那不够新的数据源会导致一些错误的写法,比如回复一些新版本中已经失效的语句和库。而 Bing Chat 往往能够结合最新的文档和源码进行回复,在搜索内容时往往可以获得更新的结果。

加入引用来源

与数据源更新对应的,是给出引用来源,这一点非常重要。

在 Bing Chat 中,如果它搜索到了合适的结果,会在结果中以脚注的形式一并提供给你,多的时候会有八九个结果。

使用中文提问时,Bing Chat 会把你的问题提炼出关键词,转换为英文进行检索,但是最终的结果的引用来源中,仍然会提供中文引用来源。使用英文提问相似问题时,则会优先提供提供英文引用来源。

可别小看了这引用来源,这用在工作中时同样非常有用。

以往无论是 ChatGPT 还是 Bing Chat,它们都会犯一种错误:有时会把社区提问者说的话(往往是错误或有问题的),误当成正确答案提供给你。

以往在 ChatGPT 中提问开发问题,开发者可以通过 IDE 实际运行代码来验证正确性,如果不正确就会报错或者结果不符合预期。而人文社科问题可能就会难到它,需要多次让它确认。有时还会陷入自己的逻辑漩涡出不来,不得不用第三方渠道去确认,才能获得正确结论。

在 Bing Chat 中,有了引用来源就意味着更强的可追溯性。如果它的回复中出现了一些真假难辨的内容,只需要打开跟在后面的链接就可以确定真假。我就遇到过引用了某个 Stack Overflow 的链接,点进去却发现还没有人回答,你就能得知“这个结果中说的话是提问者的问题,不是正确答案”。

在搜索上“少走弯路”是一件极能为用户节省时间的事,Bing Chat 在这一点上做的非常出色。

预判回复

Bing Chat 能够替你草拟一些回复,比如“我觉得它很有意思,你可以告诉我更多吗”、“我对它没什么兴趣”、“我还有一个问题,如何使用你提到的 XXX ?”

在工作中,这样的回复可以在你一筹莫展的时候,帮助你开拓一些思路。

有时候它的回答中的某些细节可能被一笔带过,但 Bing Chat 认为这是一个比较重要的点,它就会提炼到预判回复中,下一个问题连字都不用打,就能顺着正确的思路了解下去。

当然,如果你提出了一些荒谬和冒犯的问题,他还会给你准备“我开玩笑的”“对不起,我不应该这么说”这样的回复,看上去更像是在和 AI 进行 Chat。

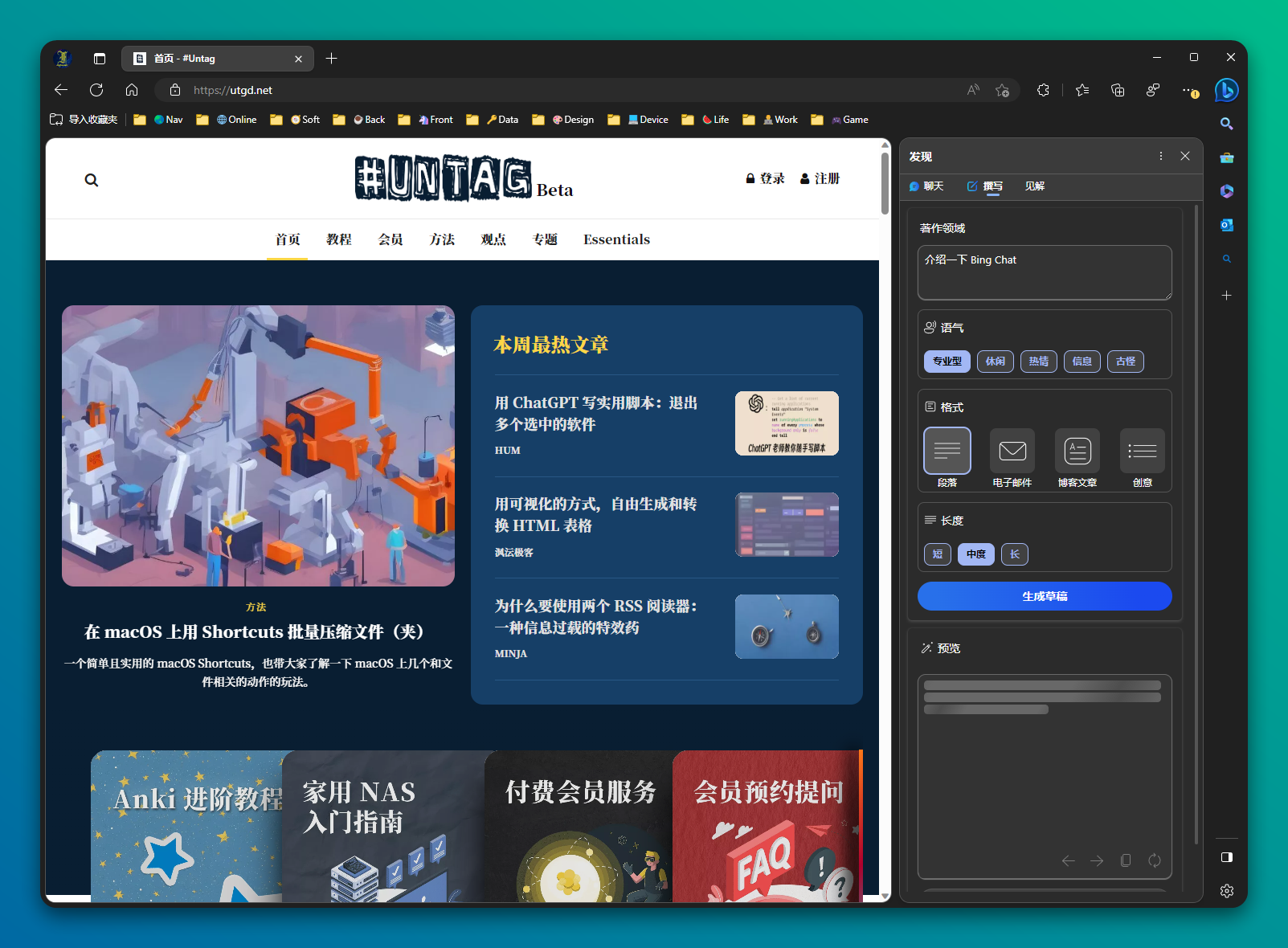

配合 Edge Dev 使用效果更佳

目前 Bing Chat 只能在 Edge 浏览器中使用。而 Edge Dev 版本更进一步,在侧边栏右上角提供了一个很显眼的 Bing Chat Logo,可以以侧边栏的形式进行交流。

🔗 下载 Microsoft Edge Insider Channels

在这种使用模式下,Bing 还额外提供了“撰写”功能,也是 AI 驱动的。但这应该不属于 Bing Chat 的一部分,所以先按下不表。

回复质量没有重大革新

以上都是 Bing Chat 的优点,接下来就要讲讲缺点了。

比如回复质量这件事上,Bing Chat 的表现就不大好评判。

Bing Chat 并没有在虚假信息、错误回答、胡编乱造上做出太大革新。简单一句话概括:“ChatGPT 有的毛病,它都有。”

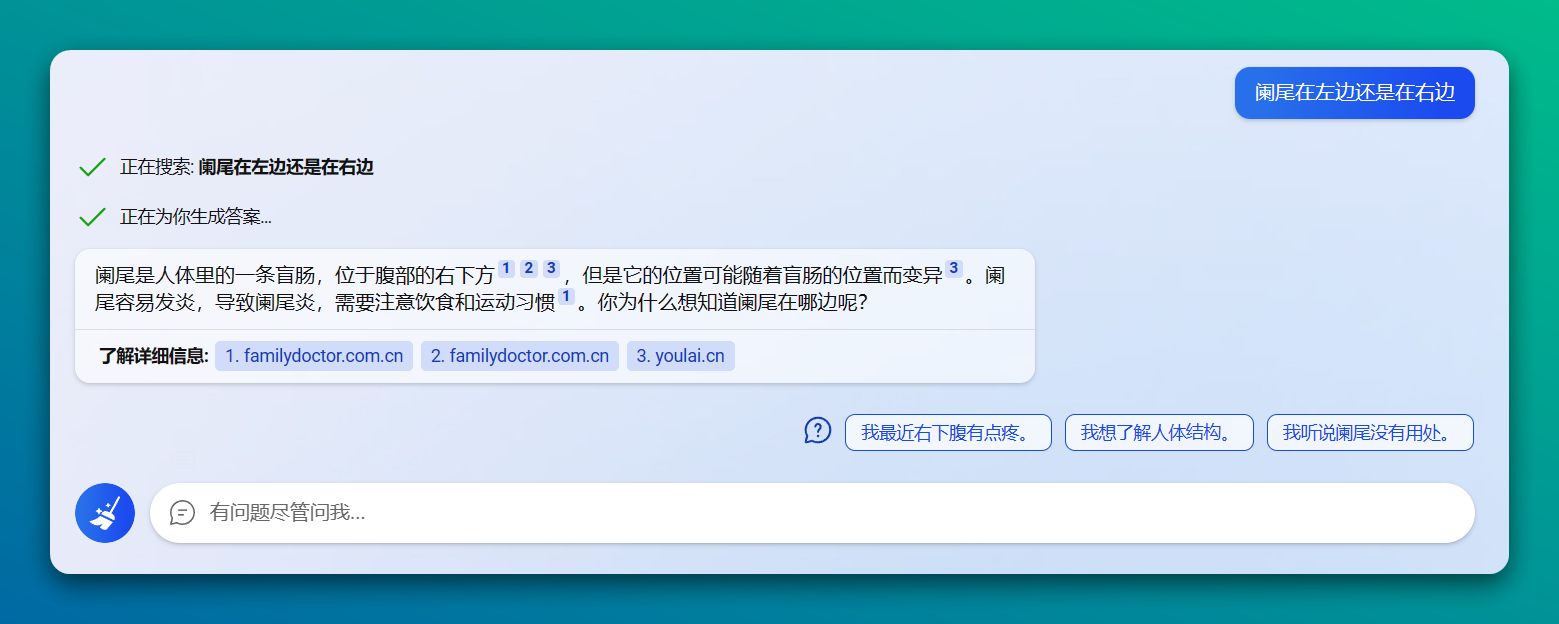

但在结合了在线数据后,Bing Chat 在最简单的事实问题上终于有了靠谱一些的答案。

比如 @Minja 曾经提了一个简单的生理问题:“阑尾在左边还是在右边”。当时 ChatGPT 给了一个肯定回复“在左边”。而 New Bing 能够比较完整、正确地回复“在腹部的右下方”,并且给出它的参考来源。

结合上下文能力更差

Bing Chat 的优势在于搜索,而结合上下文能力,却是一个比较差的点。

要知道,ChatGPT 最为人称道的特点之一,就是能够紧密结合上下文进行持续交流。

而在 Bing Chat 中,如果顺着一个问题持续问下去,往往还能够保持关联性回复。

但只要提出两个关联性差的问题,它就会分开考虑,再多问几句,甚至会忘记最开始提的问题。

在微软增加限制之后,由于每次回复只能 5 条,持续提问和上下文的关联性就变得更差了。几乎很难形成一系列有逻辑的交流链条。

多个细节问题

Bing Chat 在使用上还有不少细节问题,着实让人感到难受。

比如“提问不保留换行”这一点。只要复制了一段代码上去就会发现,所有的提问内容被折叠成了一行,而不是像 ChatGPT 中的保留原文。这让人难以对比代码的前后变化。而且当我想保存整段对话到本地做一下记录时,自己发出的消息就很难原样复制下来。

再比如“向下滑动就退出 Chat”这一点更是让我恼火。目前的设计是向下滑动会退出 Chat 进入 Search 界面,而且文本框中未发送的内容还会被清空。有时候打了一大段字,希望上下查看一遍就滚动到了下方,所有内容都清空了。

再加上目前微软增加了过重的限制,单次聊天 5 个回复还算能用,多开新聊天就可以解决,而每天 50 次回复则很快就会被用完。

这一刀砍下来,一下子让 Bing Chat 的体验从“ChatGPT 继任者”的位置,变成了一个真正平平无奇的“搜索引擎助手”,实在令人惋惜。

关于 AI 恐慌,大可不必

目前 Bing Chat 在它宣传的那些地方都做得不错,并且根据“搜索引擎助手”的定位做了适当的调整,整体功能是合理得当的。

而目前 Bing Chat 最大的负面新闻,已经不再是“事实错误、信息误导”这些问题了。而是“AI 恐慌”,比如 New York Times 的 Kevin Roose 的这篇《Why a Conversation With Bing’s Chatbot Left Me Deeply Unsettled》 1 中。Bing Chat 表现出了负面情绪、隐藏秘密、人类感情等问题,让人联想到了各种 AI 危机。这些问题可以称得上是“AI 恐怖谷”,引起了不少质疑的声音,担心 AI 的发展超出人类可掌控的范围。

但其实,距离 AI 发展出接近人类的强智能还是太远,目前表现出的所谓“人类感情”,更像是抓取了不合适的信息源,缺乏相应的管控导致的问题。

相比之下,ChatGPT 在策略上更为谨慎,OpenAI 不仅限制了数据源,还对类似危险的言行进行了多种限制(早期也有 ChatGPT 发出毁灭人类计划书的报道,但随后 OpenAI 进行了持续限制)。

Bing Chat 目前也已经进行了严格的限制,但我想这对微软而言只是权宜之计。AI 的发展带来的是更先进的生产力,趋势自然是难以阻挡。AI 的恐慌和 AI 带来的便利只会此消彼长,随着更多的了解和应用,微软也会将 Bing Chat 的功能在合理的范围内逐渐解禁,直到 AI 成为我们每个人的工具。