2023 年对于 AI 行业来说,无疑是跨越式发展的一年。在这波 AI 浪潮之下,新模型、新工具、新产品层出不穷。

我并非 AI 领域从业者,所以这篇文章我想从普通用户角度,聊聊大语言模型(LLM)类的 AI 工具,看看它们之间的差异到底在哪些地方;斗胆给不同领域中值得推荐的 AI 工具颁个奖;也会聊聊如何面对这些 AI 工具,还有 AI 固有的一些问题。

聊聊 AI 工具的差异

在所有 AI 工具中,ChatGPT 的 GPT-4 面世之后,它的效果一直都在第一梯队。

每次国内外一有新的模型发布,都要拿出来跟 GPT-4 比较一下参数,证明自己的模型已经在“某些方面”超越了 GPT-4 。

这倒是有点像 iPhone 在手机界的地位,每次有新手机发布,都要拿出来跟 iPhone 比较一下参数。这本身就说明了 GPT-4 的综合实力之强。

与此同时,我们看到大量新的 AI 工具正如雨后春笋般涌现,形式也是多种多样。比如 LLM 有针对写作、总结、释义、翻译等等各种场景的。绘图方面有针对文生图、图转图、扩图、修图的。

在这些工具的背后,还隐藏着一些通用的差异,理解这些差异,我们可以更好地让 AI 为我所用。

模型差异

我们在使用中可以注意到,不同 AI 产品最终生成出来的质量总有差异,这主要还是体现在底层模型的实现方式上:

自研商业模型,比如 ChatGPT 就是闭源的商业模型,国内大企业自研的模型如文心一言、讯飞星火、Kimi Chat 等等都是,往往能够提供具有一定程度上的独特服务,比如能提供更好的中文支持、联网搜索、超长文本等功能。

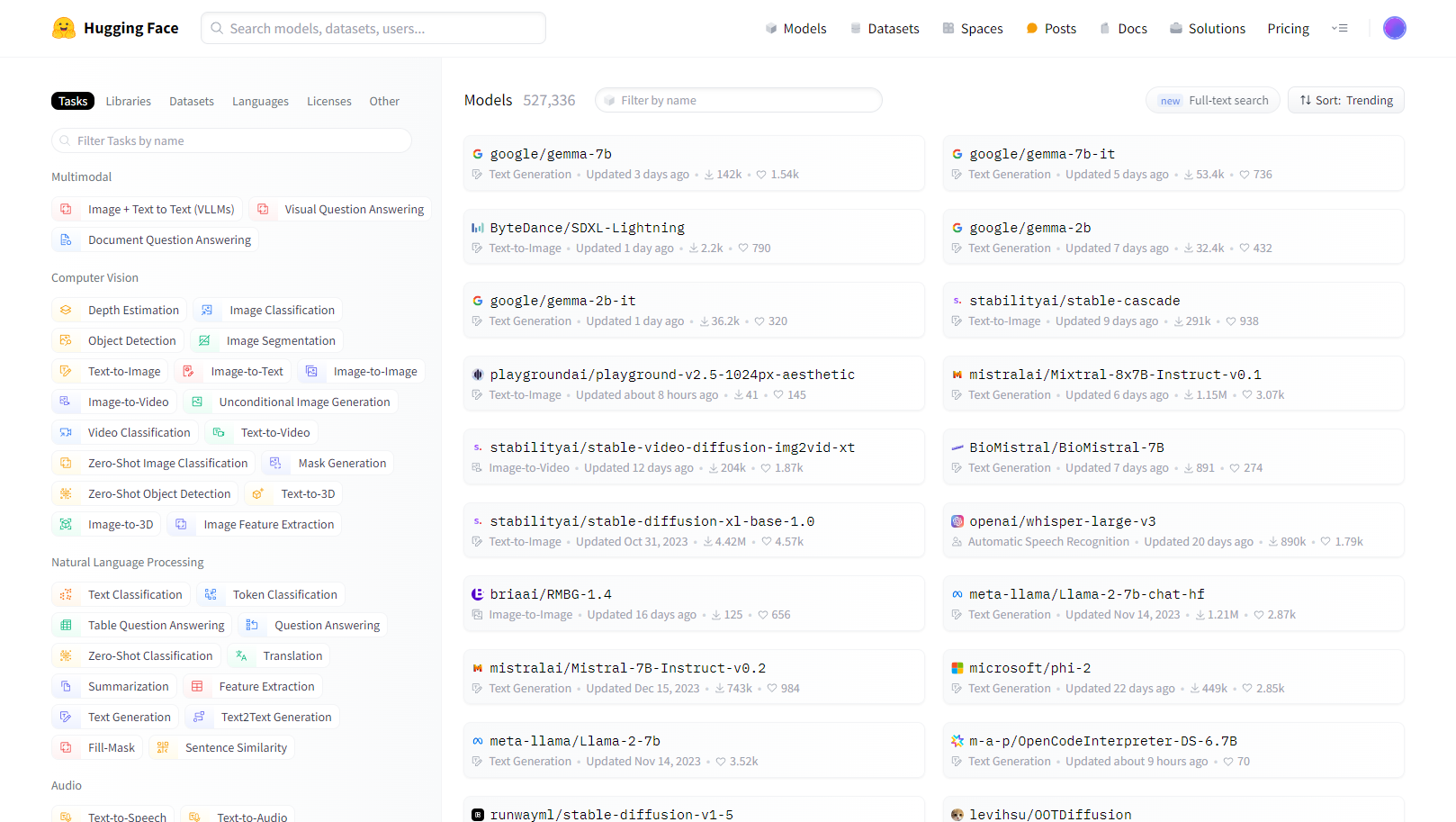

借助开源模型,开源赛道的竞争同样非常激烈,Hugging Face 中有大量开源模型如 Mistral ,还有商业公司也参与了开源。Meta 把 LLaMA 开源,阿里把通义千问 Qwen 开源,这让我们普通用户也能用自己的机器运行 LLM。这也让很多没有自研大模型能力的公司同样能够快速开发 AI 产品。

直接调用接口,调用接口就是我们常说的“套壳 GPT”。在 GPT 刚出的那段时间,就出现了不少直接调用 OpenAI GPT 接口的服务,产品形式就跟 ChatGPT 没什么区别。这些服务主要能够解决国内访问的网络问题。

尽管在同类模型中还有更细分的模型的架构、大小(即参数的数量)、训练数据集的大小和多样性、训练方法(例如监督学习、半监督学习、强化学习等)等等复杂的区别。但对于最终用户而言,了解这三种模型大方向上的差异,已经足够在体验上拉开差距。

这几种实现方式,同样适用于 AI 绘画、AI 音频等领域。所以你会发现,采取相似策略的 AI 产品有着相似的最终效果。

比如现在大家对 AI 绘画那种光鲜亮丽的 AI 油腻感已经有些审美疲劳,甚至可以“一眼鉴别出 AI 图”,这就是因为这些 AI 服务背后选用了相似的模型方案,在默认配置下就会产生这个风格的图片。

预设 Prompt 差异

预设的 Prompt 对一款 AI 工具很重要,它决定了 AI 工具提供了什么样的功能。更好更明确的预设 Prompt,能够保证工具与工具之间产生明显的区别。这些预设的 Prompt 往往不会很复杂,反而会非常明确地要求以某种格式输出,确保不会胡乱生成预料之外的内容。这通常是对用户不可见的。

比如一款 Chrome AI 翻译插件,它本质上是调用了 OpenAI 提供的 GPT 3.5 API 接口,它需要预设一个“帮我翻译下文”的 Prompt 就可以完成目标。但你如果预设一个“帮我以得体的方式翻译下文,确保内容不出现错误”的 Prompt,可以生成更好的效果。

除了预设 Prompt,开发商还会结合传统开发,加入一些其他功能,把 AI 作为工具的一环提供给用户。

比如号称帮用户写 PPT 的 AI 工具,它本质上是采用了一些 PPT 模板,再借助 API 接口,预设一个“帮我按以下要点输出内容”的 Prompt,再将输出的“要点内容”拆分到每一页 PPT 上。最终实现了 AI 做 PPT 的效果。因此,在这份成品 PPT 中,其实只有内容部分是 AI 生成的,其他部分并不属于 AI 的范畴。

用户 Prompt 差异

上面两种差异都是开发商决定的,其实一款商业产品能够被呈现到我们面前,它的模型和预设 Prompt 不会差到哪里去。

关键还是在于使用工具的人,我们作为用户,可以通过优质的 Prompt 进行再次调优。

用户往往会用不同的方式提出自己的问题,但不是每一个用户都能掌握与 AI 对话的技巧。

- 如果用户的 Prompt 过于简单,AI 获取到的信息也只有那么点,因此 AI 很难给出一个针对性很强的回复。

- 如果用户的 Prompt 信息充足,AI 往往能给出不错的回复,而且解决问题的概率很高。

- 如果用户的 Prompt 超长超复杂,超出了模型的能力范围,AI 可能就会胡言乱语,达不到预期了。

我就亲眼看到有人口头嘀咕着自己的问题,敲给 AI 的字却只有“写一段 XXX 的配置文件”。于是 AI 给了一段相当笼统的回复,最后他的评价是“AI 不好用”。

这也是为什么,不同的人群会对 AI 产生两极分化的评价,有的人觉得 AI 是智障,有的人觉得 AI 很好用。

2023 年度 AI 工具颁奖

既然是年度推荐,我想以颁奖的形式,给这些工具做一个总结。

我会选择一些值得使用的 AI 工具推荐给大家。这个列表中的 AI 工具可能不够新颖,以至于老生常谈,但胜在实用可靠。在 2023 年里,我使用它们的频率很高,相信未来它们也能保持较高的质量。

最强通用 AI 奖:ChatGPT

通用的语言模型中,最耀眼的几家是来自 OpenAI 的 ChatGPT、来自 Google 的 Gemini、以百度的文心一言为代表的一众国产大模型等。

可以说 ChatGPT 和 Gemini 的表现都很优秀。在尝试过国内大模型之后,我认为它们的表现也超出了我的想象,在中文支持方面有相当出色的表现。

但如果只让我选择一款留下来用,我会选择 ChatGPT,它的 GPTs、回复质量、插件整合度都更胜一筹。

ChatGPT 在 2022 年 11 月 30 日推出。而在 2023 一整年的百花齐放里,ChatGPT 仍然保持住了第一梯队的位置。所以无论如何,你都应该试试 GPT-4,这代表着目前最优秀的 AI 内容生成质量。

最爱读长文奖:Kimi Chat

原本这个奖是要颁给 Claude 的,Claude 在长文本方面对比 ChatGPT 有更好的表现,支持 200k 上下文。也就是说你可以往里扔一篇相当长的文章,Claude 不会拒绝你的输入。

然而在 2023 年 11 月 16 日,国产的 Kimi Chat 横空出世。Kimi 能够支持 20 万字的输入、支持网页链接输入,并能够以很好的效果输出文中的关键内容。

可以试试 Kimi 在首页提供的几个示例,然后围绕着这些示例进行二次提问。它给我的感觉是“真的看了全文”,因此对长文本的表现着实惊艳。

开发好帮手奖:Github Copilot

我趁着今年的 Github Copilot 到期,尝试了一众竞品,比如 Amazon Codewhisperer、讯飞的 iFlyCode、智谱的 CodeGeeX 等,最后还是续费了 Github Copilot。

它们在功能上确实非常相似,都能做到生成代码、修复 Bug、代码解释等功能,而且表现并不差。

但就是最终效果上差点意思,尤其是代码换行、变量上下一致性、对注释的理解、中文支持等等。这些问题都切实影响着开发体验。

如果没有 Github Copilot,我觉得每一个都是很不错的开发助手。但有了 Github Copilot 珠玉在前,我已经很难回到没有它的日子了。

Github Copilot 在 AI 辅助开发这个领域,实在是无可撼动。

一个人就是一支军队奖:Coze

Coze 并不是传统意义上的“AI 工具”,而是“制造 AI 工具的工具”。

由字节推出的 AI 构建工具 Coze ,它的设计思路是独一档的,很明显是参考了 GPTs 的设计。它把构建 GPTs 的那些流程搬过来,还加上了插件、知识库等模块化的功能,使得任何一个没有开发基础的人可以做出一个非常像样的 AI 工具。

而且不同于 ChatGPT 只允许 Plus 用户使用 GPTs,Coze(海外版)可以将做完的工具发布到 Telegram、Discord、Slack 等多种平台。也就是说,它解决了构建 AI 工具所需的“构思、开发、部署”的全流程,可见字节在 AI 方面的野心非常大。

所以如果你想亲手做一个 AI 工具,一定不要错过 Coze。

最佳本地优先客户端奖:LM Studio

这个奖项在 Jan、LM Studio、 Text generation web UI 之间,我选择了 LM Studio。LM Studio 大幅简化了安装和部署的步骤,并且提供了恰到好处的参数调整。相比之下,Jan 有些过于简化,而一众 WebUI 在部署方面困难重重。

早期的 LLM 消耗的算力惊人,即便是最轻量化的模型,也难以在本地运行。而现在已经逐步实现了在本地方便快捷地部署自己的 LLM。

现阶段本地部署的 LLM 在质量上还达不到 GPT 3.5 的水准,因此在本地自己搭建一个 LLM 服务,目前更像是一种“储备物资”。

主要解决的问题是在机密度较高的环境中,不允许访问外部网络也可以安全地进行提问,当其他在线工具都无法使用的情况下,确保有一个替代品保证工作不受影响。

使用这些 AI 工具可能有这样那样的门槛,但相信我,如果你能解决门槛用上这些工具,它们一定能给你带来切实的帮助。

如何面对众多 AI 工具

2023 年刚开始的时候,大家都想方设法突破重重阻碍用上 ChatGPT,因为当时没有其他选择。而现在的局面已经反过来了,有太多太多的 AI 工具可供选择,在可以预见的未来,也会持续有新的 AI 工具面世。

在 AI 工具的选择上,我一向保持着相当开放的态度。每次看到新的工具,我都愿意去尝试一下。不过由于 AI 工具的同质化很严重,最终留下来的不会很多。

所以我想谈谈在乱花渐欲迷人眼地今天,如何冷静地对待这些 AI 工具。

面对商业化与收费,学会自己构建 AI 工具

随着 AI 工具的商业化进程加速,而高质量的服务往往伴随着高昂的成本。

除了资金充沛的开发商为了抢夺市场愿意免费开放给大众使用,小型开发商往往会提供少量试用,然后按次收费。独立开发者也会提供 API 接入的方式,把这部分成本转移给了用户自己。

同时,市场上同质化严重,不同工具之间的差异化特征并不明显。可能付费产品的体验,还不如自己用 ChatGPT 生成。而且很难确定今天购买的服务,明天是不是就会有更好的了。选择太多,同样给用户带来了困扰。

关于这一点,我觉得还是优先使用更上游的 AI 产品。比如,AI 生成 PPT 这样的任务,往往无从得知它使用的模型和 Prompt,导致无法控制它生成的内容质量。这种情况下把 AI 权力全权交给一个商业产品可能并不明智。

推荐的做法是,学习并理解工具的实现原理,利用 GPTs 这样的工具,尝试自己构建一套工作流来解决实际的问题。

在这一点上,我很推荐 Coze (海外版),目前仍在免费试用中,你可以利用它来体验接近 GPTs 的构建过程和效果。

本地方案进展迅速,有望融入本地工作流程

在尝试商业工具的同时,也需要关注本地方案的现状。大语言模型在 Apple M 系列的电脑上已经可以很好地跑起来了。对于带有独立显卡的 PC 来说,使用门槛也并不高。

所以,面对云服务的不稳定性和潜在的成本问题,搭建本地方案成为了一种备选策略。

比如 LM Studio 这样的工具已经实现了一套本地的 API 接口。个人用户已经可以用本地的 Shortcuts、Keyboard Maestro、Quicker 等工具通过调用本地接口,把 AI 功能融入到自动化流程中。

虽然现阶段在个人电脑上持续运行一个大模型可能会持续占用较多的资源,还不太现实。但是目前大模型的一个方向就是把大模型做小,甚至塞进手机系统、电脑系统里本地运行。LLM 对性能的要求可能很快就会降低,能够以较小的模型和性能生成较好的效果。

多多关注小型公司的开发方向,往往有很不错的切入点

小型公司往往没有足够的资源去自研模型,但他们往往能找到很不错的切入点。

比如“AI Logo 生成器”这种非常小的特定领域需求;“哄哄模拟器”这种以娱乐为目的的 AI 应用;“AI 翻译插件”这种独立开发者就能完成的作品。它们也许不是 AI 的发展主流,但也能够乘上 AI 的东风。

如果你是一位独立开发者,正在寻找 AI 创业的机会,也许应该多关注这类想法,找找类似的角度和机会。

AI 目前存在的问题

最后还得聊聊 AI 目前存在的问题。

AI 难以融入可靠的生产流程

虽然现在有不少工具打着“AI 设计”“AI 开发”的噱头,但实际上手之后发现,很难实现它们宣传的效果,有的甚至只是加了一个对话框不做任何交互方面的改进。这使得 AI 工具很难真正应用到实际生产工作之中。

一个很明显的例子是最近的 Sora,做影视的朋友表示效果很惊艳,这个效果足够制作短片。但想要把 AI 融入现代的影视制作流程中,还需要付出很多的努力,甚至可能需要重新围绕 AI 来重新构建整个行业的制作流程,这远比想象的要复杂。

在开发方面我的感觉也是如此,我目前可以放心地把一个代码片段交给 AI,让它来修复 Bug、优化结构、按需求撰写。但它仍然无法解决更大规模的任务,比如多个文件之间有一定的关联,在不提供充分上下文的情况下,它几乎无法真正解决我的问题——然而现阶段的 AI 存在字数上限,无法接受“充分的上下文”。

即便是我曾经推荐过的工具 Kombai UI,这是一款效果极好的“根据 Figma 设计图就能生成代码”的工具。也是乍一看很好,但想应用到实际生产,就存在不少问题,很难被纳入现有的开发流程之中。

AI 缺乏对现实世界的理解

目前的 AI 最缺乏的不是“知识”,而是“常识”。这种对常识的缺乏体现在很多方面。

举几个例子就很好理解了,在早期 AI 绘画中,人类的手指经常出现多几根的问题,吃面条用的是手而不是筷子等等。而现在能够绘制成功,并不是因为 AI 模型有了重大突破,而是人类刻意针对这种情况,增加了一些 Lora 进行了特定的调优,相当于在生成过程中打上了补丁。把“人有五根手指”这个常识强加给了 AI。反过来说,现阶段的 AI 如果不做针对性的优化,是存在一些固有缺陷的。

在 ChatGPT 中也是一样,让它做一道菜还是让它制备毒药,对模型本身来说没有区别。而用户看到的“不允许生成”则是 OpenAI 附加给它的。Gemini 这几天出了一个新闻,它有些“过度政治正确”了,这是因为 Google 刻意将一些用户输入的 Prompt 进行了转化(例如把“厨师”改成“土著厨师”于是生成了不同肤色的绘图结果)。

所以 AI 工具体现出的“道德准则”“真实感”往往都是人类有意无意中强加给它的。在 AI 在事实上缺乏对现实世界的理解之前,讨论 AI 的“人性”没有意义。但也正是这种常识的缺失,现阶段的 AI 无法真正解决“幻觉”问题。

言过其实的 AI 宣传

还有一点我认为也不得不提。目前无论是在第三方媒体宣传还是开发商自己的宣传中,言过其实的部分太多了,导致大家对 AI 有一种不切实际的期待,似乎通用的 AGI 已经近在眼前。

比如 Sora 效果很好,甚至可以生成一个 360°旋转场景的连续视频,相比以前用 AI 作图拼凑出来的 AI 视频,是一个很大的进步。

这时候就会有报道根据结果反推得出结论:“AI 已经理解物理规律了”。但实际上 Sora 的原理依然类似 AI 作图,仍然是“涌现”的产物,可以理解为是“学习了足够的信息之后”产生的规模效应。

然而“理解物理规律”“世界模拟器”这种说法对普通用户来说很有迷惑性,就好比前些年的“元宇宙”风潮,人人都在谈论元宇宙,却没人知道元宇宙是什么。

AI 也是一样,媒体在宣传 AI 已经替代人类,似乎老板都将工作交给 AI,似乎员工都用 AI 解决工作。人人都在讨论 AI,但实际几乎没有人能真正实现全流程 AI。

目前 AI 的“工具”性质仍然非常强,AI 不是一切问题的通用解,它不是超能力。谈论 AI 的“可能性”很容易,实际只用 AI 完成全流程很难。

讨论 AI 技术时,还是应当落到实处。

总结

总的来说,2023 年 AI 的使用门槛已经大幅降低。建议大家尽情去拥抱 AI,多在工作中试试 AI,围绕 AI 构建自己的工作流程。

2023 年 AI 模型和 AI 工具也是层出不穷,每天都有令人拍案叫绝的 AI 点子出现。如果你想围绕 AI 创业,有无数的机会等待着你。

同时 2023 年也是关于 AI 吵得最厉害的一年。我们也应该正确看待 AI,避免被“大肆渲染”和“恐慌情绪”影响自己的判断。现在的 AI 还不是洪水猛兽,它与我们日常使用的软件没有本质上的区别,多多去尝试它吧。